Полная версия

Поисковое продвижение сайтов

– Размер сайта очень велик. В этом случае роботы могут неделями и месяцами добираться до созданных или измененных разделов.

– Сайт содержит большой архив страниц, которые не связаны друг с другом. Чтобы они были успешно просканированы, их нужно перечислить в файле sitemap.xml. При этом отметим, что несвязанные или слабо связанные страницы скорее всего все равно выпадут из индекса из-за маленького статического веса (на такие страницы стоит мало ссылок) и плохих поведенческих факторов (такие страницы не посещают пользователи).

✍ На заметку

По этой причине не всегда удается удержать в индексе поисковых систем нужные страницы.

Например, распространенным приемом является получение трафика с карточек старых товаров. Самих товаров уже нет и не будет в наличии (например, сняты с производства), поэтому карточки удаляются из каталога, но отображаются по прямым ссылкам, чтобы присутствовать в индексе и генерировать хоть какое-то количество трафика.

Чтобы удержать такие страницы в индексе поисковиков, можно попробовать оставить их в каталоге (пусть и на дальних позициях) с пометкой «Нет в наличии» и вариантами товаров-аналогов.

Настройка файла sitemap.xml

Помимо требований поисковых систем к оформлению файла и отдельных записей, при настройке sitemap.xml нужно выполнить следующие рекомендации:

1. Sitemap.xml должен генерироваться автоматически.

2. Sitemap.xml должен быть корректным, то есть в нем должны быть только те ссылки, которые представляют интерес для поисковых систем и пользователей. Служебные и малоинформативные разделы помещать в карту сайта нет смысла.

3. Для Sitemap лучше использовать формат XML, так как он позволяет предоставлять дополнительную информацию о страницах сайта. Для каждого URL нужно указать дату последнего обновления страницы (элемент lastmod). Также опционально можно указать:

a. частоту изменения страницы (элемент changefreq; слишком высокую частоту обновлений ставить не стоит, так как она может влиять на расходование краулингового бюджета);

b. относительную значимость страницы (элемент priority; этот параметр используется редко, так как корректно распределить веса самостоятельно на большом сайте проблематично).

4. Sitemap.xml должен обновляться не только при добавлении нового раздела, но и при изменении существующей страницы (меняется параметр lastmod).

5. Файл карты сайта не должен содержать синтаксических ошибок. Проверить это можно в панелях веб-мастеров поисковых систем.

6. Файл должен располагаться на том же домене, что и сайт, для которого он составлен, и отдавать HTTP-статус с кодом 200 OK.

7. Если Sitemap слишком большой (более 50 000 URL или весит более 10 Мб), нужно разбить его на несколько отдельных файлов, адреса которых указать в файле индекса Sitemap.

8. В файле нужно использовать кодировку UTF-8.

Остается добавить, что Sitemap.xml не дает гарантий, что роботы будут корректно сканировать и индексировать сайт, но повышает шансы на успех.

14. Оптимизация страниц с постраничной навигацией

Периодически возникает необходимость разбивать содержимое сайта на отдельные страницы. За примерами далеко ходить не надо: по страницам разбиваются списки товаров в интернет-магазинах или ветки обсуждений на форумах.

✍ На заметку

В веб-дизайне разбиение информации по отдельным страницам называется пагинацией.[50]

Пагинация используется на сайтах повсеместно, поэтому поисковые алгоритмы давно научились корректно индексировать и ранжировать такие страницы. Это можно заметить по результатам поиска – нередко там можно увидеть, например, n-ую страницу ветки форума.

Но, несмотря на широкое распространение пагинации, такие страницы зачастую требуют дополнительных усилий по оптимизации из-за ряда возможных проблем, среди которых:

1. Медленная индексация. Чем больше страниц с пагинацией на сайте, тем больше тратится краулингового бюджета на их индексирование.

В результате целевые страницы могут медленно переиндексироваться, а новые разделы сайта долго не будут попадать в базу поисковых систем.

2. Рост малоинформативных страниц в индексе. Страницы пагинации мало отличаются друг от друга и редко отображаются в результатах выдачи поисковых систем. Если таких страниц очень много, это может снизить уровень траста сайта.

Дополнительно ситуация осложняется, если количество страниц в разделе с пагинацией велико. В таком случае, чтобы добраться, например, до сороковой страницы, и роботам, и пользователям нужно сделать очень много переходов. Большой уровень вложенности делает такие страницы и контент на них еще более малозначимыми и усложняет индексацию.

3. Появление в индексе страниц с частичным дублированием контента. Такая ситуация характерна, например, для случаев, когда описательный текст для первой страницы категории отображается на всех страницах пагинации.

В данной главе мы рассмотрим основные инструменты, которые помогут сделать пагинацию на сайте более понятной для пользователей и поисковых систем.

Снижение уровня вложенности

Разберем типичный пример. Допустим, на сайте есть категория, в которой 70 страниц, а пагинация выглядит стандартно:

Предыдущая 1 2 3 4 5 6 7 8 9 1 °Cледующая

Чтобы добраться до последней страницы, и поисковому роботу, и пользователю понадобится как минимум семь кликов, что сильно затрудняет индексацию раздела.

Выходом может быть создание пагинации с «опорными» страницами следующего вида:

Предыдущая 1 2 3 4 5 10 20 30 40 50 60 7 °Cледующая

Понятно, что при клике на двадцатую страницу пользователь увидит в строке пагинации страницы с 20 по 25 включительно и опять же перечень опорных страниц. К ним можно добавить ссылки на первую и последнюю страницу пагинации.

✍ На заметку

В качестве возможного варианта можно еще попробовать выводить больше ссылок на страницы пагинации (например, не десять, а двадцать ссылок).

Ранее оптимизаторы часто выводили вообще все страницы пагинации, даже если их было несколько десятков; однако сейчас такой вариант будет смотреться слишком архаично.

Чтобы уменьшить количество страниц, также нужно повышать количество элементов на странице. Это понравится и поисковым системам, и пользователям, так как они не любят делать лишние клики – скроллить список колесиком мышки гораздо проще. Также можно доработать возможность для пользователей выбирать количество элементов на странице. Единственное, о чем нужно помнить, это скорость сайта – страницы должны грузиться быстро.

«Показать все»

Некоторые пользователи хотят увидеть информацию целиком, на одной странице. Для них стоит предусмотреть соответствующую ссылку – именно поисковая система порекомендует пользователю, если сочтет, что он ищет именно такой вариант.

При этом нужно помнить о скорости загрузки. Если информации слишком много, то страница «Показать все» будет грузиться слишком долго. В таком случае на сайте ее быть не должно.

Ссылку на страницу «Показать все» можно указать в качестве главной с помощью атрибута rel=«canonical» на всех страницах пагинации.

Оптимизация первой страницы пагинации

Так как именно первая страница пагинации зачастую участвует в ранжировании по целевым запросам, ее оптимизации следует уделить особое внимание.

Рассмотрим действия, которые нужно предпринять, на примере типичного кейса по оптимизации первой страницы категории на сайте интернет-магазина.

1. Первая страница категории должна быть оптимизирована под 2–4 целевых запроса. Для этого необходимо:

а. Заголовок категории поместить в тег

(заголовок на второй и последующей страницах можно оставить таким же).

b. Под заголовком необходимо разместить краткий лид-абзац с описанием товаров категории и вхождением ключевых слов.

Такой текст необходим, чтобы показать поисковым системам, каким ключевым запросам релевантна страница. Текст желательно разместить именно сверху под заголовком – так его точно увидят пользователи, а следовательно, поисковые системы придадут ему больше значения при ранжировании страницы.

Лид-абзац нужно показывать только на первой странице категории, чтобы избежать дублирования контента.

c. Внизу страницы нужно разместить основной текст. Как написать такой текст, сколько в нем должно быть ключевых слов, какого он должен быть размера – эти и другие моменты мы рассмотрим в главе про текстовую оптимизацию.

Так же, как и лид-абзац, такой текст стоит выводить только на первой странице категории.

✍ На заметку

Некоторые специалисты по продвижению предпочитают скрывать часть основного текста на первой странице пагинации с помощью специальных скриптов. По их мнению, большой текстовый блок портит внешний вид страницы и вредит имиджу сайта.

Такая точка зрения несостоятельна. Подробности мы разберем в главе о текстовой оптимизации, а здесь лишь отметим, что текст нужно не скрывать, а делать интересным и полезным для пользователей.

Тем не менее, если часть текста будет скрыта, необходимо убедиться, что этот текст будет доступен для поисковых роботов. Сделать это можно с помощью специальных сервисов и инструментов в панелях веб-мастеров поисковых систем[51].

2. Метатеги на первой странице необходимо задать в соответствии с ранее данными рекомендациями.

Чтобы они не повторялись на второй и последующей страницах категории, допустимо в конце тела тега заголовка автоматически добавлять идентификатор страницы, а метатег

Страница категории, на которой есть пагинация, и первая страница пагинации должны иметь одинаковый URL (без цифрового идентификатора, то есть http://www.site.ru/kategorii/igrushki, а не http://www.site.ru/kategorii/igrushki?page=1).

Динамическая подгрузка контента

Часто вместо пагинации используется динамическая подгрузка контента, которая срабатывает, если посетитель проскроллит контент до определенного момента. В этот момент с помощью JavaScript загружается следующая «порция» контента (например, следующая партия товаров в категории).

Динамическая подгрузка далеко не всегда удобна, и решение о внедрении такого механизма должно быть хорошо продуманным. При ее реализации нужно выполнить следующие рекомендации[52]:

1. Сделать и отображать на странице дублирующую статическую пагинацию, по которой поисковые роботы точно смогут проиндексировать все страницы категории (без использования JavaScript).

2. Каждая порция контента должна иметь свой URL, который нужно показывать даже при загрузке контента с помощью JavaScript. Это улучшит также и юзабилити (можно будет дать ссылку, например, на третью страницу категории).

Если следовать рекомендациям проблематично, нужно по крайней мере убедиться, что весь контент на подгружаемых страницах доступен для роботов. Как уже упоминалось выше, сделать это можно с помощью специальных сервисов и инструментов в панелях веб-мастеров поисковых систем[53].

Некоторые важные замечания

Отметим дополнительно несколько важных моментов:

1. Страницы пагинации лучше не закрывать от индексации в файле robots.txt, чтобы контент, который на них находится, индексировался и имел какую-то значимость.

2. В файл sitemap.xml нужно добавить только первую страницу рубрики, остальные поисковый робот найдет сам.

3. Ссылки на страницы пагинации не нужно закрывать от индексации с помощью rel=nofollow[54].

15. 404 ошибка

404 ошибка отображается у пользователя, если он хочет просмотреть страницу, которой нет на сайте (например, она удалена или ее URL введен неправильно)[55]. Название возникло потому, что при такой ошибке веб-серверы отправляют код статуса HTTP 404[56].

Как правило, стандартная страница 404 выглядит непрезентабельно и не содержит никакой полезной информации. Пользователи, которые попадают на такую страницу, просто покидают сайт, что негативно влияет на трафик и конверсию, а также ухудшает поведенческие факторы ранжирования.

Чтобы исправить ситуацию, необходимо создать пользовательскую версию страницы 404, которая будет отвечать следующим требованиям:

1. Код ответа данной страницы должен быть «404» (Not Found). Проверить это можно с помощью специальных сервисов [57] или плагинов для браузера[58].

2. На странице ошибки 404 нежелательно размещать рекламу, длинные тексты или графику (кроме логотипа). Страница должна быть лаконичной и простой[59].

Как вариант, если есть возможность, можно сделать эту страницу «с изюминкой»: разместить здесь яркую иллюстрацию, анимацию или мини-игру.

3. Лучше не допускать, чтобы несуществующую страницу путали с обычной. Поэтому на странице с ошибкой 404 не должно быть основного меню сайта, верстки и цветовой гаммы типовой страницы. Чем скорее посетитель поймет, что страницы не существует, тем лучше.

4. Заголовок страницы («страница не найдена») должен однозначно указывать, что запрошенной страницы не существует.

5. Чтобы помочь человеку разобраться, на странице 404 ошибки нужно дать краткую информацию о том, что произошло (например, неправильно набран адрес; такой страницы никогда не было на этом сайте; такая страница была, но по этому адресу ее больше нет).

6. На странице обязательно должны быть варианты дальнейших действий:

a. Должны присутствовать ссылки на главную страницу, важнейшие разделы, а также на карту сайта и форму поиска (если они есть).

b. Нужно предоставить пользователям возможность сообщать о неработающих ссылках (по электронной почте или через форму обратной связи).

7. Очень важно проследить за тем, чтобы 404 ошибка выводилась для ошибочных URL-адресов во всех разделах сайта. В противном случае в индекс будут попадать пустые и мусорные разделы, что ухудшит общий уровень траста ресурса.

8. Нельзя производить переадресацию при попадании на несуществующий URL, чтобы можно было исправить опечатку в адресе.

9. Необходимо помнить о том, что если страница не удалена, а просто перенесена в другой раздел, то вместо 404 ошибки необходимо настроить 301 редирект.

Помимо прочего, можно отслеживать попадание пользователей на страницу 404 с помощью средств веб-статистики (например, с помощью отчета «Параметры визитов» в Яндекс. Метрике[60]). Такой анализ позволяет не только находить неработающие ссылки, но и оценивать функциональность раздела на основе поведения пользователей и их действий.

16. Оптимизация кода сайта

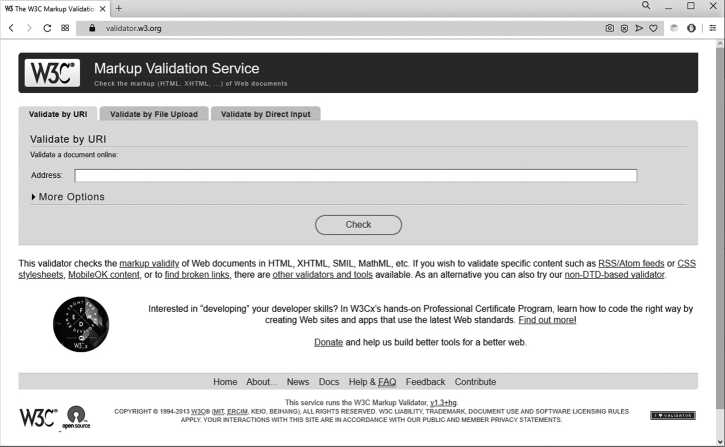

Валидность. С 1994 года функционирует Консорциум Всемирной паутины[61] (англ. World Wide Web Consortium, W3C). W3C разрабатывает для Интернета единые принципы и стандарты (называемые «рекомендациями», англ. W3C Recommendations), которые затем внедряются производителями программ и оборудования.

Проще говоря, консорциум разрабатывает стандарты, в соответствии с которыми веб-мастера создают сайты, а браузеры показывают эти сайты пользователям. По задумке это должно означать, что если код сайта соответствует стандартам (иначе говоря, код валидный), то браузеры должны его интерпретировать одинаково и у всех пользователей сайт будет отображаться корректно. Отсюда два вывода:

1. Множество ошибок в HTML-коде (несоответствий рекомендациям W3C) может свидетельствовать о плохом качестве сайта.

2. Наоборот, отсутствие ошибок в коде сайта должно свидетельствовать о высоком качестве сайта, поднимать уровень траста и позиции площадки в поисковой выдаче.

На практике все несколько сложнее. Во-первых, сами браузеры не во всем соответствуют стандарту. В отдельных технических нюансах каждый браузер умышленно не следует стандарту, а в других – его опережает, что приводит к появлению функций и механизмов, которых нет не только в стандарте, но и в других браузерах.

Во-вторых, браузеры научились справляться с ошибками в коде. Теперь, даже если сайт в отдельных моментах не соответствует стандарту, он все равно может вполне корректно отображаться у всех пользователей. Более того, требования W3C зачастую избыточны и неактуальны, а «подгонка» кода под стандарт требует от создателей сайта совершенно неоправданных затрат.

Рис. 4. Валидатор W3C – полезный инструмент для улучшения качества кода сайта

Подведем итог. Валидность (соответствие стандарту W3C) кода сайта является слабым сигналом качества сайта. Это означает, что нужно проверить код всех основных страниц сайта валидатором W3C[62] и по возможности исправить все критические (влияют на отображение сайта) и легкоустранимые ошибки.

✍ На заметку

Из легкоустранимых ошибок стоит отметить распространенную ситуацию, при которой остаются незакрытыми парные html-теги. Это минимальное требование валидности кода легко исправить, поэтому оно должно обязательно выполняться.

В идеале верстка должна быть валидна. Если получится достичь этого малой кровью – отлично, если нет – следует исправить то, что целесообразно исправлять.

Обратите внимание: чем выше уровень валидности, тем лучше. Но даже высокие показатели не гарантируют кросс-браузерности[63], то есть идентичной и корректной работы сайта во всех популярных браузерах. Поэтому необходимо периодически тестировать продвигаемый ресурс на разных устройствах, в разных браузерах и при различных разрешениях экрана.

Пристальное внимание при тестировании следует обращать на ошибки отображения сайта – ведь именно их видят посетители. Все найденные недочеты нужно задокументировать и исправить.

Мусор в коде. Мусором в программном коде сайта называются куски кода, теги и стили, не несущие полезной нагрузки.

Мусор затрудняет модернизацию сайта и может тормозить его загрузку, поэтому от него нужно избавиться.

Кодировка. На сайте с помощью тега должна быть указана кодировка html-страниц. Это нужно для того, чтобы браузер мог правильно отображать текст: если кодировка не указана и браузер ее не «угадает», вместо букв на сайте пользователь увидит иероглифы.

Тестирование. Необходимо регулярно тестировать сайт в разных режимах: отключать JavaScript, вводить неправильные URL-адреса и данные в формы обратной связи, «ломать» ресурс всеми способами, которые придут в голову. Найденные ошибки следует тщательно законспектировать, а затем устранить.

17. Распределение статических весов

Статический вес – это один из важных параметров, влияющих на продвижение сайта в целом и ранжирование конкретной страницы в частности.

Этот параметр рассчитывается индивидуально для каждой страницы и определяется количеством и качеством ссылающихся на страницу документов, к которым могут относиться html-страницы, pdf и. doc файлы, а также другие распознаваемые поисковыми системами документы с гиперссылками[64].

Вес можно разделить на внутренний (определяется количеством и качеством внутренних ссылок на страницу со всех других страниц и документов этого же сайта) и внешний (определяется внешними ссылками). Чем больше совокупный вес страницы, тем большую ценность она будет иметь в глазах поисковых систем.

SЕО-специалисты стараются всеми силами нарастить вес продвигаемых страниц. С «внешней» стороны проводится работа по наращиванию ссылочной массы (о чем мы поговорим позже). А для правильного распределения внутренних весов проводится оптимизация структуры сайта.

К каждому проекту в этом аспекте приходится подходить индивидуально, но общий принцип должен быть уже понятен: на все продвигаемые и важные страницы (услуги, категории, каталог, карточки товаров) должно стоять как можно больше внутренних ссылок. И наоборот – на нецелевые страницы (профили пользователей, технические страницы) должно вести как можно меньше ссылок (разумеется, без ущерба для удобства использования сайта).

Количественно статический вес страницы определить очень сложно, так как формулы, по которым он рассчитывается поисковыми системами, остаются неизвестными широкой аудитории. Однако это не мешает некоторым специалистам заниматься шаманством и пытаться рассчитать вес страниц с помощью каких-то формул, а на основе полученных результатов расставить внутренние ссылки на сайте. То же самое, с большим или меньшим успехом, делают специальные программы и плагины, которые автоматически расставляют ссылки на страницах сайтов, работающих на основе наиболее популярных в интернете CMS[65] (Content Management System, движок сайта).

В подобных расчетах мало смысла, так как они слишком примитивны по сравнению с математическим аппаратом, который используют поисковые системы. Однако о том, как сосредоточить вес на нужных страницах, нужно думать постоянно: в практике нередки случаи, когда добиться высоких мест по конкурентным запросам удается не в последнюю очередь благодаря правильной расстановке внутренних ссылок.

Рассмотрим несколько универсальных правил, которые помогут добиться нужного результата.

Закрываем ссылки на нецелевые страницы. Напомним, что на страницы, закрытые от индексации в файле robots.txt, лучше не ставить ссылок в пользовательской части сайта. Однако, если это все же необходимо, нужно скрыть ссылки на данные страницы посредством JavaScript таким образом, чтобы в исходном коде документов отсутствовали фрагменты вида «a href=«…».

Если в конкретном проекте это окажется сложно реализовать технически, можно попробовать закрыть ссылки на нецелевые страницы с помощью атрибута rel=«nofollow»[66]. Данный атрибут не является гарантией того, что поисковый робот не перейдет по ссылке (и не передаст вес), но это лучше, чем ничего.

Ставим ссылки на продвигаемые страницы в ручном режиме. На продвигаемые страницы следует поставить как можно больше ссылок внутри сайта. Тексты ссылок (анкоры) должны соответствовать запросам, по которым продвигаются страницы. Для простановки ссылок можно использовать:

– подвал сайта: сделать там блок с разделами каталога, поставить ссылки на продвигаемые товары и услуги);

– перелинковку (связывание страниц гиперссылками) в каталоге: блоки с самыми популярными товарами и категориями;

– виджеты, размещенные на всех внутренних страницах сайта (например, со списком услуг компании);

– основное меню сайта и другие элементы.

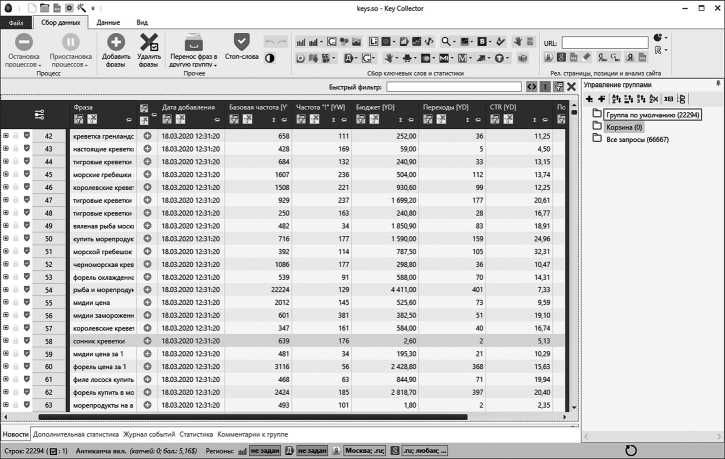

Ставим ссылки на продвигаемые страницы в автоматическом режиме. Неплохой вариант простановки ссылок в автоматическом режиме предложил в свое время Александр Люстик (создатель очень полезной программы KeyCollector[67]).

Рис. 5. Интерфейс программы KeyCollector – незаменимого помощника SEO-специалиста для работы с семантическим ядром сайта

Данный способ поможет увеличить посещаемость сайта с минимальными затратами и без риска санкций со стороны поисковых систем. Единственный недостаток алгоритма: он подойдет только для относительно больших проектов, уже имеющих неплохие показатели посещаемости и высокие позиции по ряду целевых запросов.

Суть алгоритма проста. Для больших проектов актуальна ситуация, когда одному и тому же запросу могут быть релевантны несколько страниц на сайте. Как уже упоминалось ранее, в таком случае поисковики могут понизить позиции сайта в выдаче. Поэтому необходимо собрать все эти страницы, выделить из них одну (наиболее релевантную, которая и будет показываться в выдаче) и поставить на нее ссылки с других релевантных страниц.

Таким образом мы повысим статический вес целевой страницы и подскажем поисковой машине, какой именно документ следует показывать в результатах поиска по целевому запросу. Особенно хорошо этот алгоритм может сработать при выходе сайта на «плато», когда, несмотря на усилия по продвижению, не удается повысить посещаемость сайта в течение долгого времени.

Приведем основные шаги, которые позволят реализовать алгоритм на практике:

1. Выгрузить из сервисов веб-статистики поисковые фразы, по которым пользователи заходили на продвигаемый сайт (например, за последние 3–6 месяцев).