Полная версия

Как работает мозг

IF: Goal = blah-blah-blah?

Long-Term Memory = blah-blah-blah

THEN: MARK GOAL

Yes

(ЕСЛИ: Задача = то-то и то-то?

Долгосрочная память = то-то и то-то

ТО: МЕТКА ЗАДАЧИ

Да)

Концептуальная проблема, стоящая перед системой, состоит в том, что у нее нет эксплицитного знания о том, кто чей дядя. Это знание имплицитно следует из других фактов, которые она знает. На механическом уровне то же самое будет значить вот что: в разделе «Долгосрочная память» нет метки uncle-of (дядя); там есть только метки sibling-of (брат/сестра) и parent-of (родитель). На концептуальном уровне нам нужно вывести знание о том, кто чей дядя, из знания о том, кто приходится кому родителем и братом/сестрой. На механическом уровне нам нужен демон, который сделает запись uncle-of (дядя), по обе стороны от которой будут нужные метки, обнаруженные в записях с элементами sibling-of (брат/сестра) и parent-of (родитель). На концептуальном уровне нам нужно выяснить, кто у нас родители, идентифицировать их братьев и сестер, потом выбрать из них лиц мужского пола. На механическом уровне нам нужен следующий демон, который сделает в области «Задачи» новые записи, запускающие соответствующие операции поиска в памяти:

IF: Goal = Q uncle-of Р

THEN: ADD GOAL

Find P’s Parents

Find Parents’ Siblings

Distinguish Uncles/Aunts

(ЕСЛИ: Задача = Q дядя PTO: ДОБАВИТЬ ЗАДАЧУ

Найти родителей Р

Найти братьев/сестер родителей

Различить дядь/теть)

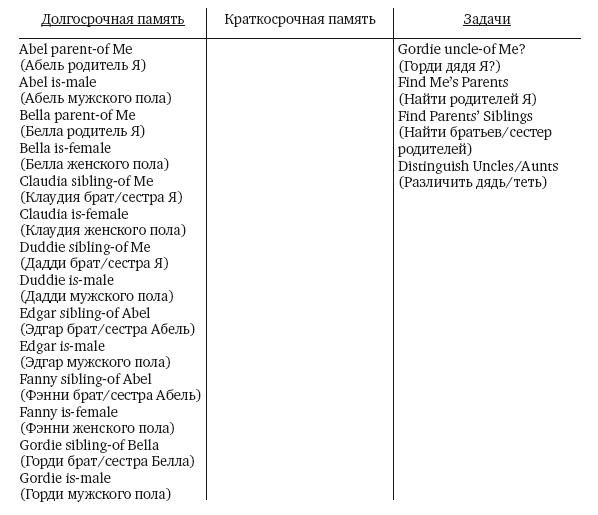

Этот демон запускается записью uncle-of (дядя) в колонке «Задачи». В этой колонке действительно есть такая запись, поэтому демон начинает действовать и добавляет к этой колонке новые метки:

Необходим также элемент программы – еще один демон или дополнительный механизм внутри данного демона, который будет отвечать за Р и Q, то есть заменять ярлык Р списком конкретных ярлыков имен: Me (Я), Abel (Абель), Gordie (Горди) и т. д. Эти детали я здесь не привожу, чтобы не усложнять восприятие процесса.

Новые записи в колонке «Задачи» побуждают к действию других демонов. Один из них (на концептуальном уровне) ищет родителей системы, копируя (на механическом уровне) все записи, содержащие имена родителей, в раздел «Краткосрочная память» (если только там уже нет таких записей, конечно; это условие необходимо, чтобы демон не продолжал бессмысленно делать одну копию за другой, как ученик чародея):

IF: Goal = Find P’s Parents

Long-Term Memory = X parent-of P

Short-Term Memory ≠ X parent-of P

THEN: COPY TO Short-Term Memory

X parent-of P

ERASE GOAL

(ЕСЛИ: Задача = найти родителей P

Долгосрочная память = X родитель P

Краткосрочная память ≠ X родитель P

ТО: КОПИРОВАТЬ В КРАТКОСРОЧНУЮ ПАМЯТЬ

X родитель P

СТЕРЕТЬ ЗАДАЧУ)

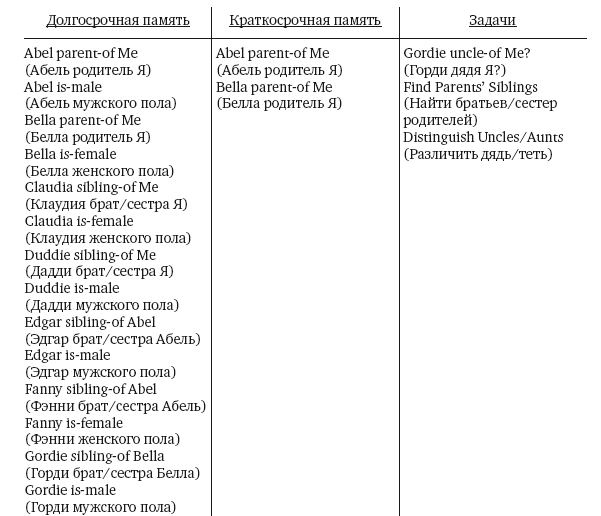

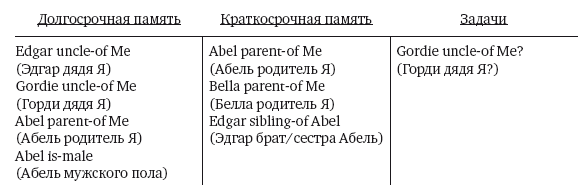

Теперь наша доска объявлений выглядит следующим образом:

Теперь, когда мы знаем родителей, мы можем найти братьев и сестер родителей. На механическом уровне это означает, что теперь, когда имена родителей записаны в разделе «Краткосрочная память», может начинать работу демон, копирующий записи о братьях и сестрах родителей:

IF: Goal = Find Parents’ Siblings

Short-Term Memory = X parent-of Y

Long-Term Memory = Z sibling-of X

Short-Term Memory

Z sibling-of X

THEN: COPY TO Short-Term Memory

Z sibling-of X

ERASE GOAL

(ЕСЛИ: Задача = найти родителей P

Краткосрочная память = X родитель Y

Долгосрочная память = Z брат/сестра X

Краткосрочная память

Z брат/сестра X

ТО: КОПИРОВАТЬ В КРАТКОСРОЧНУЮ ПАМЯТЬ

Z брат/сестра X

СТЕРЕТЬ ЗАДАЧУ)

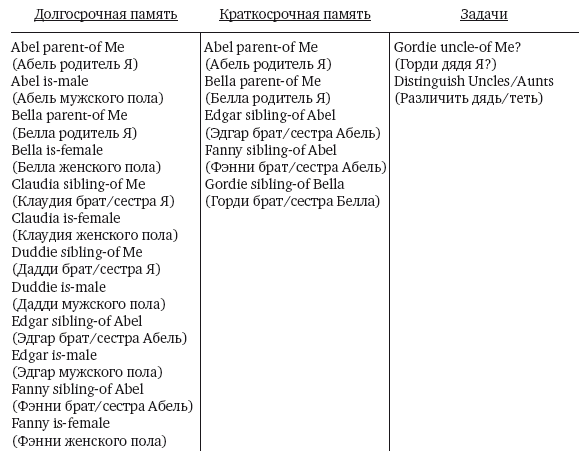

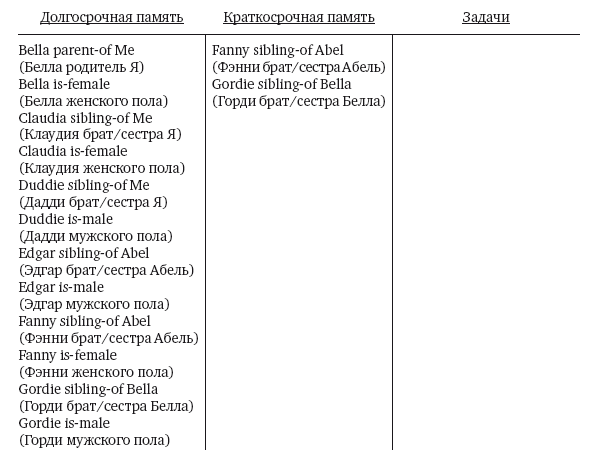

Вот что у него получается:

На данном этапе мы рассматриваем дядь и теть вместе. Чтобы отделить дядь от теть, нам нужно найти среди них мужчин. На механическом уровне система должна найти записи, рядом с которыми в разделе «Долгосрочная память» стоят метки is-male (мужского пола). Вот демон, который выполняет эту проверку:

IF: Goal = Distinguish Uncles/Aunts

Short-Term Memory = X parent-of Y

Long-Term Memory = Z sibling-of X

Long-Term Memory = Z is-male

THEN: STORE IN LONG-TERM MEMORY

Z uncle-of Y

ERASE GOAL

(ЕСЛИ: Задача = различить дядь/теть

Краткосрочная память = X родитель Y

Долгосрочная память = Z брат/сестра X

Долгосрочная память = Z мужского пола

ТО: ХРАНИТЬ В ДОЛГОСРОЧНОЙ ПАМЯТИ

Z дядя Y

СТЕРЕТЬ ЗАДАЧУ)

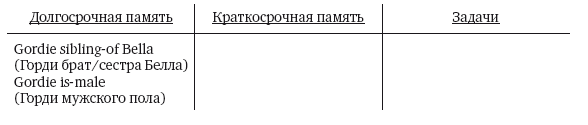

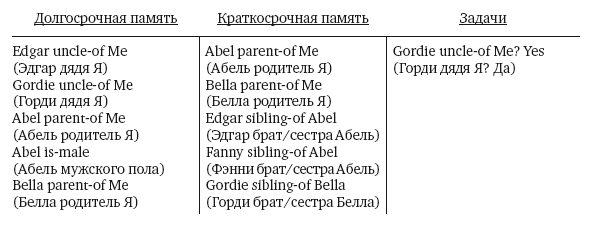

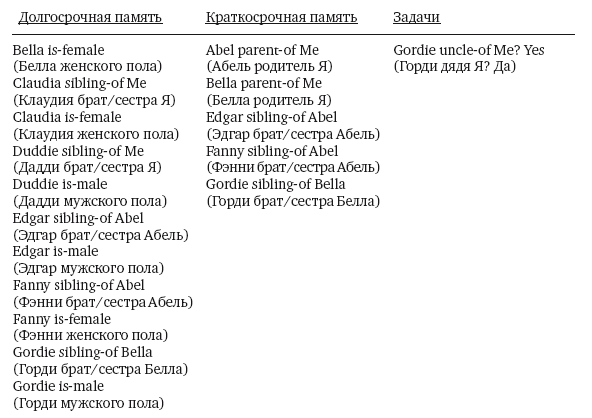

Это демон, который наиболее явно воплощает в себе понимание системой значения слова «дядя»: это человек мужского пола, брат одного из родителей. Система добавляет запись о том, кто является дядей, в раздел «Долгосрочная память», а не «Краткосрочная память», потому что эта запись представляет собой элемент знания, который всегда истинен:

На концептуальном уровне мы всего лишь логически вывели факт, который был запрошен. На механическом уровне мы только что создали идентичные друг другу вплоть до последней метки записи в колонках «Задачи» и «Долгосрочная память». Запускается самый первый из упомянутых мной демонов, который осуществляет поиск таких пар; он ставит метку, обозначающую, что задача решена:

Чего мы достигли? Мы построили из безжизненных деталей автомата по продаже жвачки систему, которая делает нечто, отдаленно напоминающее работу мышления: она устанавливает истинность утверждения, с которым ранее никогда не имела дела. Из утверждений о конкретных родителях, братьях и сестрах и знания о том, что значит быть чьим-то дядей, она выработала истинные утверждения о конкретных дядях. И все это, повторю еще раз, было сделано путем обработки символов – материальных изображений, обладающих репрезентативными и каузальными свойствами, то есть одновременно способных нести в себе информацию о чем-либо и принимать участие в цепочке физических событий. Указанные события и составляют процесс вычисления: вычислительные механизмы задуманы таким образом, что если интерпретация символов, запускающих машину, является истинным утверждением, тогда и интерпретация символов, синтезированная машиной, тоже является истинным утверждением. Вычислительная теория сознания – это гипотеза о том, что интеллект как раз представляет собой вычисление в этом значении слова.

«Это значение» довольно широко и позволяет избежать дополнительных посылок, связанных с другими определениями вычисления. Так, нам не нужно принимать в качестве исходного положения, что вычисление состоит из последовательности отдельных шагов, что символы должны либо явно наличествовать, либо явно отсутствовать (в противопоставление градации признака: более выраженный – менее выраженный, более активный – менее активный), что мы гарантированно получим правильный ответ за ограниченный промежуток времени, или что истинное значение должно быть «абсолютно истинным» или «абсолютно ложным», а не подразумевать вероятность или некоторую степень уверенности. Таким образом, вычислительная теория охватывает и альтернативный вариант компьютера с множеством элементов, активных в той или иной степени, в зависимости от вероятности того, что то или иное утверждение истинно или ложно; компьютера, в котором уровень активности может постепенно меняться, отражая новые и приближенно точные вероятности. (Как будет показано ниже, вполне возможно, что именно так работает мозг.) Главная идея заключается в том, что ответ на вопрос «Что делает систему умной?» – не материя, из которой сделана система, и не какая-то особенная энергия, протекающая через нее, а то, для чего предназначен каждый из элементов машины, и каким образом закономерности изменений внутри системы отражают соответствующие параметру истинности отношения (включая случаи, когда истинность является вероятностной или недостаточно четко определенной)71.

Естественные вычисления

Почему вычислительной теории сознания можно верить? Потому что это теория, которая позволила разрешить многовековые проблемы философии, стала началом компьютерной революции, подняла ключевые вопросы нейробиологии и дала психологии потрясающе плодотворное поле для исследований.

Целые поколения мыслителей безрезультатно ломали головы над тем, каким образом мышление взаимодействует с материей. Как сказал Джерри Фодор, «жалость к себе может довести до слез, и лук тоже». Как могут наши неосязаемые убеждения, желания, представления, планы, цели отражать мир вокруг нас и давить на рычаги, с помощью которых мы, в свою очередь, меняем мир? Декарт через много столетий после смерти стал посмешищем для ученых (и совершенно незаслуженно), потому что высказал идею о том, что мышление и материя – разные виды вещества, которые каким-то образом взаимодействуют в части мозга, называемой шишковидной железой. Философ Гилберт Райл высмеял эту идею, назвав ее «доктриной призрака в машине»72 (эту фразу позже использовали в качестве заголовка для книг писатель Артур Кестлер и психолог Стивен Косслин и рок-группа «Полис» в качестве названия своего альбома). Райл и другие философы утверждали, что такие термины ментализма, как «убеждения», «желания» и «представления», бессмысленны и происходят от небрежной, неправильной трактовки языка. Имеющие схожие взгляды бихевиористы заявляли, что говорить о невидимых сущностях так же ненаучно, как верить в Зубную Фею, и старались полностью исключить их из своих психологических теорий.

А потом появились компьютеры: не имеющие ничего общего с феями и невидимыми сущностями куски железа, работу которых никак нельзя было объяснить без полного арсенала «запретных» словечек ментализма. «Почему мой компьютер не печатает документ?» – «Потому что программа не знает, что ты заменил струйный принтер на лазерный. Она до сих пор думает, что говорит со струйным принтером, и пытается распечатать документ, прося принтер подтвердить получение сообщения. Но принтер не понимает ее сообщение и игнорирует его, потому что ожидает, что вводные данные будут начинаться с символа “%”! Программа отказывается вернуть управление, пока она продолжает разговаривать с принтером, поэтому тебе нужно привлечь внимание диспетчера задач, чтобы он отобрал управление у программы. Как только программа узнает, какой принтер к ней подключен, они начнут общаться». Чем сложнее система и чем опытнее пользователи, тем больше обсуждение технических деталей напоминает сюжет мыльной оперы.

Философы-бихевиористы все-таки продолжали бы настаивать на том, что все это праздные разговоры. Машины на самом деле ничего не понимают и не пытаются, сказали бы они; просто пользователи легкомысленно подходят к выбору слов и поэтому рискуют поддаться на соблазн серьезных концептуальных ошибок. И все же, что здесь не так? Философы обвиняют компьютерщиков в недостаточной ясности мышления? Да ведь компьютер – это самый формальный, педантичный, реалистичный, неумолимый ревнитель точности и недвусмысленности во Вселенной. Судя по формулировке обвинения, можно подумать, что это компьютерщики в замешательстве зовут на помощь философов, когда у них перестают работать компьютеры, а не наоборот. Гораздо лучшее объяснение состоит в том, что вычислительная теория наконец позволила развеять туман мистики, окутывавший менталистские термины: убеждения – это записи в памяти, желания – это записи в разделе задач, мышление – это вычисления, запускаемые датчиками, попытка – это выполнение операции, запускаемое задачей.

(Вы возразите, что мы, люди, что-то чувствуем, когда у нас возникает убеждение или желание или ощущение, а обычная запись в памяти не способна создавать такие чувства. Справедливое замечание. Но давайте попытаемся не смешивать проблему объяснения интеллекта с проблемой объяснения осознанных ощущений. Пока я пытаюсь объяснить, что такое интеллект; а до сознания мы дойдем чуть позже в этой же главе.)

Вычислительная теория сознания также позволяет реабилитировать раз и навсегда печально известного гомункула. Типичное возражение против идеи, что мысли – это внутренние репрезентации (это возражение очень популярно среди ученых, старающихся всячески показать, насколько они прагматичны), состоит в том, что если есть образ, то в голове должен быть маленький человечек, который на него смотрит, а если есть маленький человечек, то должен быть человечек еще меньше, который смотрит на образы в голове первого человека, и так далее, до бесконечности. Но вот перед нами в очередной раз тот же самый спор: теоретик упорно убеждает инженера-электрика в том, что, если инженер прав, то в его рабочей станции должны жить толпы крошечных человечков. В вычислительной технике без гомункулов не обойтись. Здесь постоянно считываются, интерпретируются, анализируются, распознаются и проверяются структуры данных, и подпрограммы, которые за это отвечают, без зазрения совести называют «агентами», «демонами», «контроллерами», «диспетчерами», «интерпретаторами». Почему все эти разговоры о гомункулах не ведут к бесконечному регрессу? Потому что внутренняя репрезентация – это не реалистичная фотография мира, а гомункул, который «смотрит на нее», – не миниатюрная копия всей системы, обладающая таким же интеллектом. В этом случае это бы и в самом деле ничего не объясняло. Нет, репрезентация – это совокупность символов, соответствующая тому или иному аспекту мира, и каждому гомункулу остается только реагировать несколькими заранее предписанными действиями на некоторые из этих символов: эта задача гораздо проще того, что делает вся система в целом. Интеллект системы образован действиями не столь интеллектуальных механических демонов внутри нее. Эту мысль, впервые высказанную в 1968 году Джерри Фодором, следующим образом сформулировал Дэниел Деннетт:

Гомункулы превращаются в призраков только в тех случаях, когда они полностью дублируют те способности, которые они должны были объяснить… Когда получается сделать так, чтобы команда или комитет относительно невежественных, ограниченных и зашоренных гомункулов обеспечивали разумное поведение в целом, это уже успех. Блок-схема программы обычно представляет собой схему организационной структуры комитета гомункулов (экспертов, библиотекарей, счетоводов, администраторов); каждый блок схемы определяет гомункула, предписывая некую функцию, но не уточняя, как ее выполнить (в самом деле, мы ведь говорим «назначить человечка выполнять ту или иную работу»). Далее, если мы посмотрим повнимательнее на отдельные блоки, то увидим, что функция каждого из них выполняется путем ее разбиения при помощи другой блок-схемы на еще более мелких и более глупых гомункулов. В конце концов, помещая одни блоки внутрь других, мы придем к гомункулам настолько глупым (все, что от них требуется, это отвечать на вопросы «да» или «нет»), что их можно, так сказать, «заменить машиной». Мы можем исключить из схемы сказочных гомункулов, организовав для выполнения работы целые армии идиотов73.

Вероятно, вы по-прежнему задаетесь вопросом, каким образом метки, которые пишут и стирают демоны внутри компьютера, представляют или обозначают вещи в реальном мире. Кто решает, что данная метка в системе соответствует данному кусочку мира? В случае с компьютером ответ очевиден: мы решаем, что обозначают эти символы, потому что мы создаем машину. Но кто определяет значение символов, которые якобы присутствуют в нашей голове? В философии данная проблема известна как проблема «интенциональности» (этот термин может ввести в заблуждение, потому что интенциональность не имеет ничего общего с намерениями; англ, intentionality образовано от intention, у которого помимо специального логического значения «интенция» есть также общеязыковое значение «намерение». – Прим. пер.) На этот вопрос есть два широкоизвестных ответа. Первый – что символ связан с референтом (обозначаемым объектом) в реальном мире посредством наших органов чувств. Лицо матери отражает свет, который возбуждает зрительные рецепторы, что приводит к каскаду эталонов или подобных схем, которые вписывают символ мать в ваше мышление. Второй ответ – что уникальный паттерн манипуляций с символами, запускаемый первым символом, отражает уникальный паттерн взаимоотношений между референтом первого символа и референтами инициируемых символов. Если мы условимся (какими бы ни были причины) говорить, что символ мать обозначает мать, дядя обозначает дядю, и так далее, все новые утверждения о взаимном родстве, генерируемые демонами, чудесным образом вновь и вновь будут оказываться истинными. Устройство напечатает утверждение Bella mother-of Me (Белла мать Я) – и будет право, потому что Белла и впрямь моя мать. Символ мать обозначает мать, потому что он выполняет определенную роль во всех умозаключениях о матерях.

Эти две теории известны как теория причинно-следственной связи и теория инференциальных ролей, и для опровержения каждой из них оппонентами было выдумано немало нелепых мысленных экспериментов. Эдип не хотел жениться на своей матери, но все равно это сделал. Почему? Потому что эта женщина вызвала в его сознании символ Иокаста, а не символ мать, а его желание было сформулировано как «Если это мама, не женись на ней». Причинное влияние символа Иокаста (а это женщина, которая на самом деле была матерью Эдипа) здесь были нерелевантны; единственное, что имело значение, – это инференциальная роль, которую играли в голове Эдипа символы Иокаста и мать. Молния ударяет в сухое дерево посреди болота, и каким-то чудесным образом болотная тина сливается в точную копию меня в данный момент, воспроизводящую меня вплоть до молекулы, включая мои воспоминания. Этот Болотный человек никогда не видел мою мать, но большинство людей сказали бы, что его мысли о матери будут о моей матери – точно так же, как и мои собственные мысли. Отсюда также следует вывод, что символу не обязательно быть связанным причинно-следственными связями с чем-либо в этом мире, чтобы напоминать о чем-то; достаточно его инференциальной роли74.

И все-таки… Предположим, что последовательность действий по обработке информации, выполняемых компьютером, играющим в шахматы, оказывается по какому-то удивительному стечению обстоятельств аналогичной событиям на поле боя в ходе Шестидневной войны[8]: королевский конь = Моше Даян, ладья на с7 = израильская армия захватывает Голанские высоты и т. д. Можно ли будет сказать, что эта программа в такой же степени воспроизводит Шестидневную войну, в какой она воспроизводит игру в шахматы? Предположим, однажды мы обнаружим, что кошки – вовсе не животные, а очень похожие на животных роботы, управляемые с Марса. Любое правило логического вывода, которое приведет к выводу «если это существо – кошка, то это животное», будет недействительным. Инференциальная роль нашего ментального символа кошка в этом случае изменится до неузнаваемости. Однако значение символа кошка останется неизменным: вы все равно подумаете «кошка», увидев крадущегося мимо робота по кличке Феликс. Уже два очка в пользу теории причинно-следственной связи.

Третью точку зрения можно кратко выразить фразой из пародии на телерекламу в передаче «Субботним вечером в прямом эфире»: «Вы оба правы – это мастика для натирки пола и украшение для десерта». Что обозначает символ, определяют каузальная и инференциальная роли символа в сочетании. (С этой точки зрения мысли Болотного человека будут о моей матери, потому что у него будет ориентированная на будущее каузальная связь с ней: он узнает мою мать, если встретит ее). Каузальная и инференциальная роли обычно бывают синхронизированы, поскольку благодаря естественному отбору наши системы восприятия и модули логического вывода в этом мире по большей части работают правильно. Не все философы согласятся с тем, что сочетания причинности, инференции и естественного отбора достаточно для такого описания понятия «значение», которое будет идеально работать в любой альтернативной Вселенной. («Предположим, у Болотного человека есть идентичный близнец на другой планете…») Но если его и достаточно, ответим мы, тем хуже для этой концепции значения. Значение может иметь смысл только относительно устройства, которое было создано (инженерами или естественным отбором) для работы в данном, конкретном мире. Иными словами, насчет Марса, Болотной страны или Сумеречной зоны сказать наверняка ничего нельзя. Даже если с философской точки зрения наша теория каузальности в сочетании с инференцией не совсем совершенна, она по крайней мере снимает покров тайны с того, каким образом символ в нашей голове или в компьютере может что-то обозначать75.

Еще один признак того, что вычислительная теория сознания на правильном пути, – существование искусственного интеллекта: компьютеров, которые выполняют интеллектуальные задачи, посильные только для человека. В любом магазине подержанной аппаратуры вам продадут компьютер, который превосходит человека по способности вычислять, хранить и находить данные, строить чертежи, проверять орфографию, переправлять почту и набирать текст. В хорошо укомплектованном магазине программного обеспечения вам предложат программы, которые отлично играют в шахматы, распознают буквы алфавита и отчетливую речь. Покупатель с кошельком потолще может позволить себе программы, способные поддерживать разговор по-английски на ряд тем и управлять роботизированной рукой, выполняющей сварку и покраску, и не уступающие человеку по мастерству в сотнях областей – таких, как подбор акций, диагностика болезней, назначение лекарств, устранение неполадок в оборудовании. В 1996 году компьютер «Дип Блю» обыграл в одиночной партии чемпиона мира по шахматам Гарри Каспарова. Еще две партии закончились вничью, а последнюю компьютер проиграл; можно сказать, что всего лишь вопрос времени, когда компьютер окончательно победит чемпиона мира. Роботов такого класса, как Терминатор, в мире пока нет, однако есть тысячи менее масштабных программ искусственного интеллекта – в том числе они есть у вас в компьютере, в машине и в телевизоре. И это не предел.

Эти скромные успехи заслуживают внимания в связи с горячими спорами по поводу того, что компьютеры вскоре смогут или, наоборот, никогда не смогут делать. Одна сторона дебатов заявляет, что появление роботов уже не за горами (что доказывает, что мозг – это компьютер), а вторая утверждает, что этого никогда не будет (что доказывает обратное)76. Создается ощущение, что эта дискуссия сошла со страниц книги «Говорят эксперты» Кристофера Серфа и Виктора Наваски:

Знающие люди уверены, что передавать голос по проводам невозможно, а если даже это и было бы возможно, то не принесло бы никакой практической пользы.

Редакционная статья в журнале «Бостон пост», 1865 годПятьдесят лет спустя… мы откажемся без абсурдной необходимости выращивать целую курицу, чтобы съесть грудку или крылышко, и начнем выращивать эти части по отдельности в подходящих условиях.

Уинстон Черчилль, 1932 годЛетающие машины тяжелее воздуха невозможны.

Лорд Кельвин, исследователь в области термодинамики и электричества, 1895 год[К 1965 году] автомобиль высшего класса будет около 20 футов длиной, работать будет на энергии газотурбинного двигателя, младшего брата реактивного двигателя.

Лео Черне, издатель-редактор «Ресерч инститьют оф Америка», 1955 годЧеловек никогда не долетит до Луны, невзирая на все будущие научные достижения.

Ли Дефорест, изобретатель вакуумной лампы, 1957 годПылесосы, работающие за счет ядерной энергии, станут реальностью через 10 лет.

Алекс Льюит, производитель пылесосов, 1955 год77Единственное явно справедливое утверждение, следующее из рассуждений футурологов, – что в будущем все их рассуждения будут выглядеть глупо. Мы не можем знать пределов возможностей искусственного интеллекта, его достижения будут зависеть от того, с какими практическими сложностями столкнется его развитие. Не подлежит сомнению лишь одно: вычислительные машины могут обладать интеллектом.