Полная версия

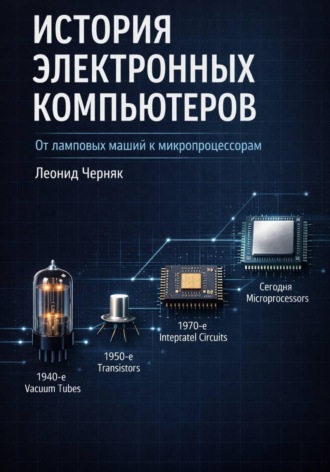

История электронных компьютеров

В 1963 году Роберт Норман изобрел более совершенную биполярную SRAM, а в 1964 году Джон Шмидт создал 64-битную MOS-p-канальную SRAM. В апреле 1969 года Intel выпустила Intel 3101, первую промышленно произведенную SRAM. С тех пор SRAM постоянно совершенствовалась и к 1995 году стала стандартом для кэширования процессоров в серверах.

DRAM: идея и реализация

В отличие от SRAM, история DRAM насыщена событиями и повлияла на все устройства: от серверов до смартфонов. Ей человечество обязано сотруднику IBM Роберту Деннарду (1932).

Деннард родился в Техасе, получил бакалавра и магистра в Далласе (1954 и 1956), а Ph.D. в 1958 году в Технологическом институте Карнеги в Питтсбурге. В IBM он занимался исследованиями памяти. Идея создания DRAM пришла к нему как инсайт, напоминающий притчу о Ньютоне и яблоке: после долгой встречи коллег по улучшению ферритовой памяти он заметил очевидные недостатки – низкую скорость и трудоемкость ручной сборки.

При этом его проект MOS-SRAM был перспективным, но требовал шесть транзисторов на один бит. Тогда Деннарду пришла мысль: а нельзя ли обойтись одним транзистором, используя заряд конденсатора для хранения 0 или). Идея показалась слишком смелой, и некоторое время IBM не воспринимала ее всерьез.

В 1967 году Деннарду удалось довести проект до патентной заявки на однотранзисторную DRAM, выданной в 1968 году. В 1970 году Intel создала успешный 1-килобитный DRAM-чип, а к середине 1970-х появились 4-килобитные чипы с однотранзисторной ячейкой. Рост емкости шел по закону Мура.

Деннард сам признавал: «Я знал, что это будет большая вещь, но не знал, что она будет иметь такое широкое влияние, какое имеет сегодня».

DRAM доминирует и используется в виде Double Data Rate Synchronous DRAM (DDR SDRAM) – синхронной динамической памяти с высокой скоростью передачи данных.

Интегральные микросхемы

Создание интегральных микросхем (Integrated Circuit, IC) открыло путь к компьютерам третьего поколения. Часто термин чип используют как синоним IC в корпусе с контактами, но точнее называть чипом сам полупроводниковый кристалл с электронными компонентами, а корпус – лишь его конструктивной оболочкой.

Историю IC часто упрощают, сводя ее к двум именам – Джека Килби и Роберта Нойса, которых называют «отцами интегральной схемы». На самом деле в развитии технологии участвовали десятки инженеров и ученых, а заслуги Килби и Нойса до сих пор вызывают споры. Присуждение Нобелевской премии Килби также считается некоторыми исследователями спорным, ведь речь шла не об одиночном изобретении, а о становлении целой отрасли.

Идея объединить несколько транзисторов на одной подложке возникла еще в 1949 году у немецкого физика Вернера Якоби, который собрал пять транзисторов в усилитель – по сути, первую интегральную схему. Однако его работа осталась экспериментом.

В 1952 году английский инженер Джеффри Даммер, позже названный «пророком IC», писал: «С появлением транзистора станет возможным создавать схемы в виде единого модуля без соединительных проводов». Он даже сделал модель твердотельного триггера как монолитный блок, но без необходимых технологий практического применения добиться не удалось.

• В 1950-е годы появлялись прототипы интегральных схем:

• Харвик Джонсон и Торкель Уоллмарк из RCA подали заявку на однокристальный генератор.

• Артур Д’Азаро и Иэн Росс из Bell Labs создали счетчик для телефонии.

• Японец Ясуро Таруи предложил собственную концепцию интеграции.

Даже неудачный «четырехслойный диод» Шокли можно рассматривать ка попытку объединить функции нескольких компонентов в одном кристалле. Все эти разработки оставались узкоспециализированными.

Прорыв обеспечил Джек Килб из Texas Instruments. В 1958 году он доказал возможность размещения транзисторов, резисторов и конденсаторов на одном кристалле и соединения их между собой. В 1959 году TI представила первую коммерческую интегральную схему – двоичный триггер.

Однако соединения Килби выполнялись вручную золотыми «летающими» проводками, что делало процесс дорогим и ненадежным (одна схема стоила около 500 долларов – дороже лампового аналога). Формально Килби создал интегрированную схему, но не микросхему: его элементы были размером 0,1–1 мм («мезоуровень»). Настоящие ИС стали появляться только с переходом к микроуровню (1–100 мкм), а затем к наноуровню.

Килби был изобретателем, а не исследователем-физиком, и не решил ключевых задач, тем не менее его эксперимент продемонстрировал принцип универсальной интеграции. Главный практический прорыв сделали инженеры Fairchild Semiconductor.

• Жан Эрни предложил покрывать транзисторы диоксидом кремния, что привело к планарной технологии.

• Роберт Нойс применил ее для создания первой кремниевой монолитной схемы.

• Курт Леговец разработал изоляцию p—n-переходами, сделавшую массовое производство возможным.

Fairchild в 1960-е годы стала центром интегральной революции. Брюс Дил, Эндрю Гроув, Эд Сноу и их коллеги провели фундаментальные исследования взаимодействия кремния и диоксида кремния, которые легли в основу классического учебника Гроува Physics and Technology of Semiconductor Devices.

Патентные споры между TI и Fairchild длились много лет. Верховный суд США признал приоритет Fairchild. В 2000 году Килби получил половину Нобелевской премии «за вклад в изобретение интегральной схемы». Это решение носило компромиссный характер: к тому времени Нойс уже умер, а патентные войны остались в прошлом. Историк Бо Лоек отметил: «Идея Килби была настолько непрактична, что от нее отказались даже в TI. Его патент имел ценность лишь как объект торга».

Сегодня история IC рассматривается как результат коллективной работы множества изобретателей. Главное, что интегральная схема стала фундаментом современной микроэлектроники, а не продуктом одиночного гения.

Микропроцессоры

Почему мы все еще говорим «микропроцессор»?

Когда в 1970-х годах появились первые интегрированные процессоры, слово «микро» указывало на то, что весь управляющий функционал, который на тот момент занимал несколько компьютерных плат, а еще раньше одну или даже несколько стоек, теперь оказался собран на одной кристаллической подложке, которая, собственного говоря, называется чип. Этот чип заключают в корпус с внешними контактами, на первых в 70-х их было от 100 до 200, в наиболее мощных современных до 6000. Вот этот пирожок с начинкой-чипом и называется микропроцессором. Подчеркнем, чип – это только начинка. Но не только размер, еще префикс «микро» связывают с тем, что многие современные CPU работают под управлением специального уровня управления, его называют микроархитектурой. Этот уровень непременная часть одной из двух разновидностей архитектуры, именуемой CISC (complex instruction set computing или complex instruction set computer). Альтернативная версия – архитектура с жестко запрограммированными командами RISC (reduced instruction set computer), здесь команды обрабатываются напрямую аппаратном уровне, без промежуточного микрокода. В последние годы граница между CISC и RISC постепенно размывается.

CISC и RISC

На протяжении более чем полувека микропроцессоры развивались по двум независимым траекториям. Первоначально доминировала архитектура, которую позже назвали CISC (Complex Instruction Set Computer). Она появилась в индустрии в 1970-х годах и характеризовалась сложными командами, способными выполнять несколько действий за одну инструкцию. Программисту было проще писать код, а сам код получался компактным. За это процессору приходилось тратить больше времени на декодирование команд, сложнее было распараллеливать выполнение и оптимизировать конвейер.

Примерно через десять лет появилась академическая парадигма RISC (Reduced Instruction Set Computer). В отличие от CISC, RISC использовала простые, компактные инструкции, которые чаще всего выполняются за один такт процессора. Сложные операции разбивались на несколько простых команд. Преимущества RISC проявлялись в высокой скорости работы, простоте конвейеризации и хорошей масштабируемости. Недостатками были увеличенный объем кода и более сложная компиляция.

В 1980-х обе архитектуры сосуществовали как отдельные парадигмы: CISC росла в недрах индустрии, обеспечивая удобство программирования и компактность кода, а RISC развивалась в академической среде, делая упор на скорость и эффективность исполнения инструкций. Параллельное существование этих подходов объясняется тем, что они решают разные задачи и обладают уникальными преимуществами в определенных условиях.

Современные процессоры часто комбинируют элементы обеих архитектур. Это позволяет использовать преимущества CISC в компактности и удобстве программирования, а RISC – в скорости выполнения и эффективной конвейеризации. Таким образом, история архитектур процессоров – это история постепенного сочетания двух подходов, каждый из которых развивался почти независимо, но в итоге дополнил другой.

CISC–Intel, восхождение, доминирование и уступка трона

Когда в 1971 году компания Intel представила миру первый коммерческий микропроцессор – Intel 4004, никто еще не знал, что начинается новая технологическая эра. Микросхемы размером с ноготь стали сердцем цифровой революции, а сама Intel – ее главным мотором.

На протяжении четырех десятилетий Intel удерживала лидерство в индустрии микропроцессоров. Ее продукты стояли внутри подавляющего большинства персональных компьютеров, от офисных машин до домашних игровых станций. Слоган «Intel Inside» стал символом надежности, производительности и статуса.

Хронология доминирования:

• 1980-е: архитектура x86 закрепляется как индустриальный стандарт.

• 1990-е: Pentium становится нарицательным именем; компьютеры ассоциируются с Intel.

• 2000-е: линейка Intel Core возвращает компании лидерство после кратковременного успеха AMD.

В это время AMD и другие конкуренты существовали – иногда даже догоняли, но почти никогда не опережали. Intel задавала темп, определяла архитектурные стандарты и даже диктовала, как будет выглядеть будущее вычислений.

Точка перегиба: замедление гиганта

Но у каждой империи есть предел господства. У Intel он начался, казалось бы, с незначительного, но рокового сбоя: компания не справилась с переходом на более тонкий техпроцесс – с 14-нм на 10-нм. То, что должно было случиться в 2016 году, откладывалось до 2019 и далее. В то время как TSMC, крупнейший контрактный производитель чипов, шагнул вперед и начал осваивать 7-нм техпроцессы, на которых работали уже и Apple, и AMD.

В 2017 году AMD представила архитектуру Zen – и внезапно стала снова опасным соперником. Серия процессоров Ryzen показала отличную многопоточную производительность, а серверные процессоры EPYC начали теснить Intel в ее, казалось бы, неприступной крепости – дата-центрах.

AMD предлагала больше ядер, меньше энергопотребления и лучшую цену. Это изменило правила игры. Если раньше Intel могла позволить себе медленные итерации, теперь это стало роскошью.

Apple и ARM: уход в другое измерение

В 2020 году еще один удар пришел из неожиданного направления. Apple отказалась от процессоров Intel, на которых работали ее ноутбуки и десктопы более 15 лет, и перешла на собственные чипы, построенные на архитектуре ARM. Так родился Apple M1 – энергоэффективный и невероятно мощный процессор, который потряс рынок.

ARM-чипы давно доминировали в смартфонах и планшетах, но с M1 стало ясно: они могут тягаться и с «большими» x86-процессорами. Intel пропустила революцию мобильных устройств – и теперь теряла позиции и в мире настольных решений.

2020-е: трон шатается

К началу 2020-х годов Intel столкнулась с конкуренцией сразу с нескольких фронтов:

• AMD – в классических x86-компьютерах и серверах.

• Apple и ARM – в мобильных и десктопных устройствах.

• TSMC – в области производства полупроводников, где Intel отстала по техпроцессу.

Финансово это стало ощутимо: в 2021 году TSMC обогнала Intel по рыночной капитализации, а в технологическом плане – ее лидирующая позиция была поставлена под сомнение впервые за десятилетия.

В 2021 году у руля Intel встал ветеран индустрии Пэт Гелсингер. Под его руководством компания объявила масштабную стратегию по модернизации производств, разработке новых архитектур и вхождению в рынок контрактного производства – прямой конкуренции с TSMC.

Цель – вернуть Intel в статус не просто одного из игроков, а лидера. Будет ли это возможно? Вопрос пока открыт.

Intel была символом цифровой эпохи. Она фактически изобрела микропроцессор, сделала его массовым продуктом и десятилетиями диктовала правила игры. Но даже самые могучие технологические империи сталкиваются с вызовами. Сегодня она больше не единоличный владыка микропроцессорного трона. Но если история чему-то учит – в том числе и история самой Intel – так это тому, что даже гиганты способны на второе дыхание.

История RISC

RISC (Reduced Instruction Set Computer) – это архитектурный подход, при котором используется малое количество простых и быстро исполняемых инструкций. Предпочтение отдается командам одинаковой длины и формата, основной упор делается на работу с регистрами, а не с памятью. Главная идея RISC проста: чем проще инструкция, тем быстрее и эффективнее ее выполнение.

Три школы RISC: три взгляда на простоту

В начале 1980-х годов в разных точках США почти одновременно родились три проекта, которые заложили фундамент концепции RISC. Каждый из них отражал свой подход к мышлению, проектированию и контролю над сложностью. Это проекты IBM 801, Berkeley RISC и Stanford MIPS. Они развивались независимо, но объединяет их общий дух – дух нового времени, когда громоздкие, многозначные инструкции уступили место простым, быстрым и управляемым конструкциям.

Хронологически первый прообраз RISC появился не в университете, а в корпорации IBM в середине 1970-х. Проект 801, названный по номеру здания, разрабатывался для телекоммуникационного оборудования. Автор, инженер Джон Кок, увидел, что большинство сложных CISC-инструкций не ускоряют выполнение программ, а наоборот, мешают. В результате родилась архитектура, где каждая инструкция короткая, однозначная и выполняется за один такт.

Почти одновременно профессор Дэвид Паттерсон в Калифорнийском университете в Беркли запустил проект, ориентированный изначально на обучение студентов архитектуре компьютеров. Паттерсон подошел к RISC как ученый: анализировал статистику использования инструкций и выявлял, какие реально ускоряют работу программ. Проект Berkeley RISC стал первой архитектурой, напрямую названной RISC, и оказал огромное влияние на последующие ARM и SPARC.

Третий путь открыл Джон Хеннесси в Стэнфорде. Его проект MIPS (Microprocessor without Interlocked Pipeline Stages – микропроцессор без взаимоблокирующих стадий конвейера) был академическим, но сразу ориентированным на реальные продукты. Хеннесси тесно работал с компиляторами, считая, что они должны брать на себя большую часть ответственности за оптимизацию кода.

Первые RISC-процессоры

Процессор IBM 801 никогда не продавался как коммерческий продукт; он использовался внутри IBM для телекоммуникационных систем. На его основе появились IBM ROMP – первый RISC в коммерческом продукте (рабочая станция IBM RT, 1986) и архитектура POWER/PowerPC, применяемая в суперкомпьютерах, игровых консолях и серверах.

Berkeley RISC (RISC I, 1981; RISC II, 1983) был реализован в университетской лаборатории на кремнии с частотой до 3 МГц. Эти чипы служили исследовательской целью, но оказали большое влияние на архитектуру SPARC (Sun Microsystems, 1987), которая широко использовалась в рабочих станциях.

Stanford MIPS появился в 1984 году. В 1985 Хеннесси основал MIPS Computer Systems, и вскоре были выпущены первые коммерческие процессоры: R2000 (1986) и R3000 (1988), применявшиеся в UNIX-системах и игровых приставках. В 1990-х MIPS использовался в продуктах SGI, Cisco и Sony (PlayStation 1).

Что осталось из первых RISC и кто выжил?

Большая часть классических MIPS-процессоров уже не выпускается для массового рынка, но архитектура продолжает жить в специализированных и встроенных системах. SPARC сохранялся в серверном сегменте, однако компании постепенно переходят на x86 или ARM. IBM POWER – самый живой представитель классического RISC, активно развивающийся и применяемый в суперкомпьютерах, мощных серверах и мэйнфреймах IBM Z.

Современные процессоры сочетают идеи CISC и RISC. Например, процессоры Intel и AMD содержат RISC-ядра, на которых выполняются сложные CISC-инструкции в виде микроопераций. Это позволяет сочетать богатство x86-инструкций и эффективность RISC-исполнения. ARM же остается классическим RISC с огромной экосистемой, доминируя в смартфонах, встроенных системах и серверных решениях, постоянно улучшая поддержку 64-битных расширений (ARMv8 и далее).

Период 2000–2025: Конец безальтернативности

В период с 2000 по 2025 годы архитектура x86 постепенно теряет статус безальтернативного стандарта. В мобильной и встраиваемой технике ее начинают теснить RISC-процессоры, такие как ARM и MIPS. На десктопах и серверах x86 по-прежнему удерживает позиции за счет традиций, огромной программной базы и совместимости.

В начале 2000-х развернулась «битва частот»: процессоры Athlon и Pentium 4 демонстрировали все более высокие тактовые частоты. Intel столкнулась с проблемой перегрева, а AMD выигрывала в эффективности. В 2003 году AMD представила архитектуру x86-64 (AMD64), добавив 64-битность к x86 без отказа от старых программ. Этот шаг позволил архитектуре работать с большими объемами оперативной памяти и сохранил совместимость со старым ПО.

В 2006 году Intel вернула лидерство с выходом процессоров серии Core. Переход к многоядерным решениям и энергосберегающим технологиям сделал Intel Core 2 Duo новым стандартом для настольных и серверных систем.

С 2010-х годов ARM стремительно набирает популярность в мобильных устройствах: iPhone и Android выводят x86 из мобильного рынка, а попытка Intel Atom конкурировать с ARM оказалась неудачной. В 2017 году мировое сообщество столкнулось с уязвимостями Spectre и Meltdown, которые затронули процессоры обеих архитектур.

В 2020 году Apple полностью отказалась от x86, выпустив собственные процессоры Apple Silicon (M1 и последующие), показывая, что ARM способен превосходить x86 по энергоэффективности даже на десктопе. В 2023–2025 годах x86 теряет эксклюзивность: Microsoft выпускает Windows на ARM, а специализированные ИИ-чипы (NPU, GPU, TPU) забирают часть вычислений у CPU. Сегодня x86 остается важной архитектурой для корпоративного и ПК-сегмента, но больше не является «центром мира» вычислительной техники.

Apple и ARM

Когда в 2007 году Apple выпустила первый iPhone, внутри него находился ARM11 – простой и энергоэффективный процессор. Выбор ARM был очевиден: эта архитектура идеально подходила для мобильных устройств, где важны компактность, энергосбережение и низкое тепловыделение. Уже тогда Apple поняла: архитектура важнее, чем частоты и мегабайты.

С 2010 года, начиная с A4, Apple самостоятельно разрабатывает процессоры на базе ARM. С каждым поколением (A5, A6, A7…) они становились все мощнее, опережая конкурентов по производительности на ватт. В A7 Apple впервые представила 64-битную мобильную архитектуру, чем опередила индустрию минимум на два года. К концу 2010-х чипы Apple A-серии уже были ближе к десктопному классу, чем к традиционным мобильным решениям.

С появлением iPad Pro стало очевидно: ARM-чипы Apple выходят за пределы «мобильного». A12X, A14X – это полноценные вычислительные платформы с высокой графической и вычислительной производительностью. Именно в iPad Pro архитектура Apple Silicon впервые начала напоминать то, что позже окажется в Mac.IV. Переход на

В 2020 году Apple объявила о переходе с x86 (Intel) на собственные ARM-чипы – Apple Silicon. Первый из них, M1, стал настоящим технологическим прорывом:

• Собственные высокопроизводительные и энергоэффективные ядра.

• Интеграция CPU, GPU, RAM и Neural Engine в одном чипе.

• Unified Memory Architecture: единая шина между компонентами.

• Поддержка Rosetta 2 для запуска x86-приложений без значительной потери скорости.

RISC–V: открытая архитектура, которая меняет правила игры

Еще недавно мир процессоров был жестко поделен. На персональных компьютерах – x86 от Intel и AMD, в смартфонах и встраиваемой электронике – ARM. Любой, кто хотел сделать собственный чип, был обязан покупать лицензию и играть по правилам владельцев архитектуры. Это ограничивало свободу и тормозило эксперименты.

В 2010 году в Калифорнийском университете в Беркли группа ученых решила попробовать другой путь. Они разработали RISC–V – простую и свободную архитектуру команд, которая изначально задумывалась как удобный инструмент для обучения и исследований. Но идея оказалась гораздо сильнее учебного проекта.

Главное новшество RISC–V в том, что ее спецификация открыта для всех. Это не готовый процессор, а набор правил, описывающих, какие команды понимает машина. Любая компания, университет или энтузиаст могут на ее основе создать собственное ядро: крошечный микроконтроллер для датчика, процессор для смартфона или даже чип для суперкомпьютера.

Архитектура устроена модульно. Есть минимальный набор инструкций, необходимый для запуска системы, а дополнительные возможности подключаются как расширения: арифметика с плавающей точкой, работа с векторами, криптография. Такой подход делает RISC–V гибкой: она подходит и для простейших устройств, и для высокопроизводительных решений.

Исторические корни RISC–V

RISC–V вырос не на пустом месте. Его предшественниками были ранние проекты по созданию RISC (Reduced Instruction Set Computer) – «процессоров с сокращенным набором команд».

В конце 1970-х годов Дэвид Паттерсон и его команда в Беркли создали RISC–I и RISC–II. Их идея была в том, чтобы вместо сложных и медленных инструкций сделать небольшой, но быстрый набор команд. Это оказалось эффективнее: упрощенный процессор мог работать быстрее и использовать меньше транзисторов.

Эти разработки породили целое поколение промышленных архитектур: MIPS, SPARC, PowerPC, ARM. Каждая из них добилась успеха в своем сегменте – от серверов до мобильных устройств.

Однако со временем большинство таких архитектур стали закрытыми и дорогими для лицензирования.

RISC–V, появившийся в 2010-м, стал возвращением к истокам: это пятая исследовательская архитектура из Беркли (отсюда «V» в названии). Она сохранила дух RISC – простоту и эффективность – и при этом добавила то, чего раньше не было: открытую спецификацию, доступную каждому.

Хронология развития

2010 – старт проекта в Беркли.

2014 – публикация первой версии спецификации.

2015 – основание некоммерческой организации RISC–V Foundation (позже RISC–V International).

2018–2019 – к проекту подключаются крупные компании: NVIDIA, Western Digital, Google.

2020-е – выход готовых процессоров на RISC–V, использование в IoT, контроллерах памяти, суперкомпьютерах.

Можно сказать, что RISC–V – это аналог Linux в мире железа: открытая основа, на которой каждый строит свое. И, как и с Linux, сначала это казалось академической забавой, а теперь все больше похоже на новую технологическую реальность.

Графический процессор: от рендеринга к ИИ

В начале было изображение

В 1980-х компьютеры умели показывать графику, но делали это неохотно. Центральный процессор (CPU) рисовал все – от иконки до трехмерного объекта, – а его архитектура, заточенная под последовательную обработку, страдала от перегрузки. Когда на горизонте появились видеоигры, стало очевидно: нужен новый подход.

Так появились первые графические ускорители. Они брали на себя простейшие графические операции – наложение текстур, рендеринг спрайтов – и быстро стали неотъемлемой частью игровых ПК и рабочих станций.

Рождение GPU: NVIDIA и ATI

В 1999 году NVIDIA представила GeForce 256, устройство, в котором маркетологи впервые употребили термин "Graphics Processing Unit" (GPU). Это был качественный скачок: GPU стал самостоятельным вычислительным блоком с возможностью аппаратной трансформации, освещения и обработки треугольников. CPU, наконец, перестал быть обязанным делать все сам.